Selon Andrew Leonard, journaliste et auteur du livre Bots : The Origin of New Species, un bot est « un programme informatique autonome supposé intelligent, doué de personnalité, et qui habituellement, mais pas toujours, rend un service ». On peut penser au bot informatique comme à un assistant personnel qui s’occupe de tâches fastidieuses pour le bénéfice de son créateur. À titre d’exemple, un bot est capable, à travers les moteurs de recherche, de suivre un sujet en mode continu et envoyer un signal à son utilisateur dès qu’un contenu d’intérêt est publié / trouvé. On peut penser aussi au web crawler, un bot également, qui feuillette le World Wide Web pour faire le référencement des pages et des sites web, ou bien au très connu chatbot « Siri », qui répond aux questions et à certaines demandes des détenteurs de iPhones. D’ailleurs, dernièrement on constate l’utilisation des bots informatiques à des fins politiques par des gouvernements à travers le monde pour imiter les utilisateurs des médias sociaux afin de manipuler l’opinion publique. Selon Samuel Woolley, candidat PhD à l’Université de Washington, plus de 40 pays ont déployé des bots politiques en 2015 ; dans le cadre de son travail, l’équipe a réussi à enregistrer plus de 100 bots conçus expressément pour influencer les élections et diffuser de la propagande pendant les crises politiques au Mexique, en Turquie et en Russie entre autres.

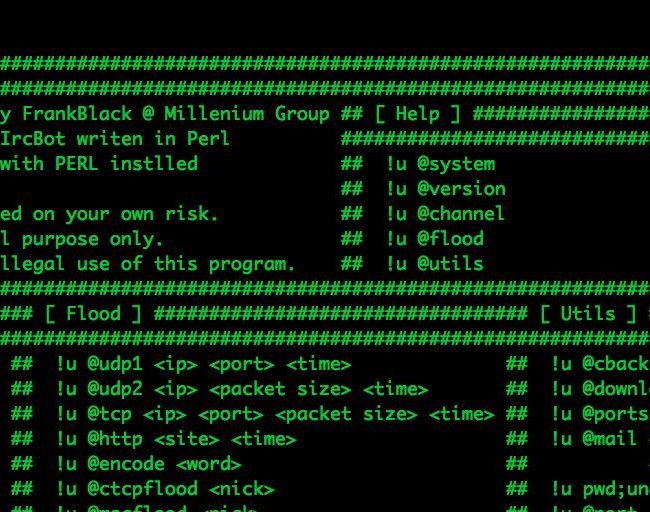

Comme tout autre outil inventé par l’homme, on peut se servir des bots à des fins nobles, neutres ou tout à fait malhonnêtes – c’est le cas notamment des bots conçus pour faire des cyberattaques. Les tâches exécutées par ces bots couvrent toute la gamme d’attaques possibles : de l’envoi de spam à la destruction de sites Web, dans le cadre d’une attaque par déni de service. Étant donné qu’un ordinateur infecté par un bot est complètement soumis à son créateur / maitre, on parle d’ordinateurs « zombies ».

« Les bots [criminels] se répandent souvent sur Internet à la recherche d’ordinateurs vulnérables, non protégés, afin de les infecter. Lorsqu’ils trouvent un ordinateur exposé, ils infectent rapidement la machine puis envoient un rapport à leur maitre. Leur but est alors de rester cachés jusqu’à ce qu’ils soient réveillés par leur maitre pour accomplir une nouvelle tâche. » (Norton by Symantec)

On peut rapidement remarquer qu’on peut en faire un nombre exhaustif d’usages, bons- tout comme malintentionnés. Mais qu’arrive-t-il lorsqu’un bout de code, programmé à surfer sur le web pour acheter des produits aléatoires, se procure des biens illégaux ? Dans un scénario pareil, qui serait responsable – le bot ou bien son créateur ? C’est une situation similaire qu’ont vécue les autorités Suisses en 2015, lorsqu’un bot élaboré par un groupe d’artistes dans le cadre d’une exposition d’art a acheté, sur le marché AlphaBay dans le web invisible, dix pilules de MDMA (connues aussi sous le nom d’Ecstasy), un passeport hongrois très convaincant et une paire contrefaite de chaussures Nike, entre autres.

Quoique les artistes aient accepté de prendre la pleine responsabilité pour les actions du bot, des accusations criminelles n’ont pas été portées contre eux. En l’occurrence, ils pouvaient prévoir la possibilité que des biens illicites soient acquis, étant connu que le marché AlphaBay liste des biens illégaux. Néanmoins, il serait intéressant d’imaginer une situation hypothétique où il n’y avait aucun moyen raisonnable pour le programmeur du bot de prévoir les actions criminelles de ce dernier – dans ce contexte, qui serait responsable ?

Au Canada, dans la majorité des cas, pour qu’une personne soit trouvée coupable d’une infraction criminelle, elle doit avoir commis un acte illégal (actus reus) et doit avoir « l’état d’esprit » nécessaire ou « l’intention de commettre l’acte » (mens rea) pour constituer l’infraction criminelle.

Alors, quel serait le verdict d’un juge si le programmeur était capable de démontrer qu’il n’avait aucune intention criminelle et si les actes illicites du bot n’étaient que des effets secondaires involontaires au fil de sa quête ?

Il serait probablement que selon les règles de droit actuelles… personne. Heureusement, on n’a pas encore atteint le point où les bots soient complètement autonomes et aptes à commettre des actes criminels entièrement dissociables de la volonté du programmeur, mais ces questions persisteront néanmoins – ce n’est probablement qu’une question de temps avant que ceci ne devienne une réalité.